为了防止你看不到最后,我把核心的内容放在开头,后面是一些相对啰嗦的说明

分享一个学习群论的绝佳的书单,和群论的实际应用

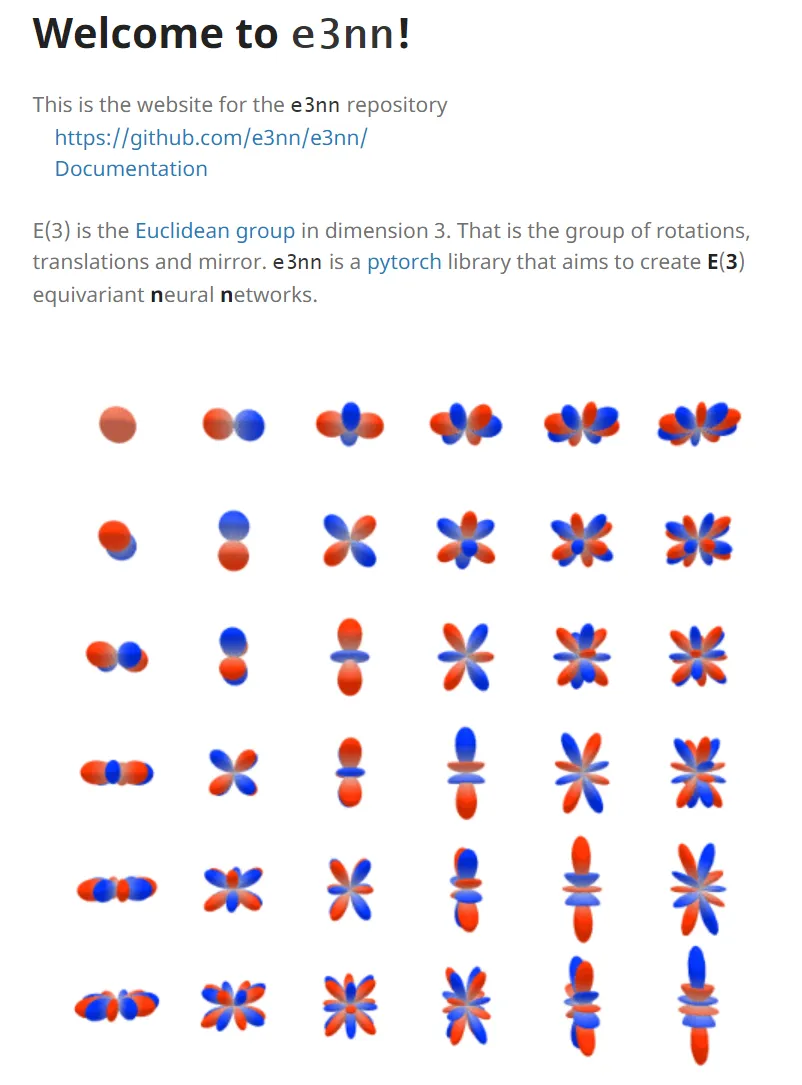

https://e3nn.org/ 提供了许多非常棒的群论参考资料,其本身是一个机器学习的库,但是设计的原则是完全基于群论的,其中介绍的书,我觉得更适合自学(作者如果觉得某一章写的不够fun,他甚至会在最后附上一些笑话来补偿一下读者,是的没错就是这本working in progress的书,数理笑话用完了之后甚至还插入了一些奇奇怪怪的笑话,我不好评价)。

这个网站所代表的e3nn计算框架则是阿姆斯特丹AI实验室的人员开发的,他们的研究聚焦于几何机器学习,可以访问他们的官方网站查看更多。我个人非常推荐这个在Youtube上的ICLR2021 Keynote:深度学习的埃尔朗根纲领的视频,即使不论内容,其表现形式也值得大家学习,很难得能看到这样精心准备的高质量科研报告。

一些可看可不看的废话

对我们学校大多数同学来说,群的四个基本性质(closure, associativity, identity, inverse)应该都不陌生,循环群、交错群之类的也遇到过很多了。群论是研究对称性的一门学问,但即使是上完了群论1的课程,我也对此理解很一般(我学习的时候喜欢有直观的图像,而群论1的课程,除了一部分需要考验空间想象能力之外,更多的都是公式定理的证明,非常abstract)。

但是,由物理系开设的这门群论课,我知道吸引了一些计算机、数学、化学方向同学的兴趣,他们主要感兴趣的是群论在“量子计算”、“结构化学”这些领域的应用,而物理系,很多同学是听说这在“量子力学”、“固体物理”里面有很多应用(可能还因为班主任在教这门课)才来选择的。

不过老师自己做的是高能物理(粒子物理),讲的主要是群论的基本定理,而选课的许多人量子力学尚未开始学习,因此没有太多应用和深入,让人学完觉得屠龙之技无处施放。

我就是这样的一个同学,即便在学了量子力学,知道角动量理论、CG系数和群论的不等价不可约表示关系密切之后,我实际上也很少用到群论。

但就在最近,当我开始学习深度学习的时候,名为等变神经网络的东西吸引了我,因为它声称这种神经网络,能保持输入数据的很多对称性,而对称性在物理中占有核心的地位,这不得不看看了。

于是我读了好几篇ICLR(机器学习顶会)的论文,还读了一些研究者发布的lecture note。文中有一些很有意思的结论,而我不曾在之前看过的任何一个介绍神经网络的书中读到。而这神经网络架构的数学理论几乎是全部建立在群论上面的。

其中一个核心的定理,说明了一件事:任何保持群对称性的线性映射都是卷积。换句话说,卷积神经网络(一个深度学习广泛采用的东西),本质上就是普通的神经网络+平移对称性(我相信很多CS的同学对CNN的平移对称性很熟悉,但应该没被告知,卷积网络可以从我们最熟悉的前馈全连接神经网络推导而来(毕竟这是2019年的ICLR的工作))。然后作者在此基础上,推广了卷积的定义,从我们通常的那个卷积推广到了群卷积(Group Convolution),并以此设计并完成了一个具有E(3)不变性的神经网络库(e3nn)。在此,我把这个优美的定理放出来

(我表述的时候略去了很多细节,比如$\mathcal{L}_g^X$其实是群元$g\in G$在空间$X$上群作用的左正则表示,希望深入理解的同学还是参考note为好)

Theorem 3.2 (Equivariant Linear Maps are Group Convolution)

Assume $\mathcal{K}:\mathbb{L}_2(X) \to \mathbb{L}_2(Y)$ is linear and bounded, $X$ and $Y$ are homogeneous space of group $G$, if we want

$$ \mathcal{L}_g^Y\circ \mathcal{K}=\mathcal{K}\circ \mathcal{L}_g^X $$

then

1) $\mathcal{K}$ satisfies

$$ (\mathcal{K}f)(y)=\int_X

\Big[

\frac{d\mu_X(g_y^{-1}x)} {d\mu_X(x)}

\Big]

k(g_y^{-1}x)

f(x)

d\mu_X(x)$$

2) $k$ satisfies

$$ k(x)= \frac{d\mu_X(g_y^{-1}x)} {d\mu_X(x)}

k(h^{-1}x)$$

for any$h\in H = \text{Stab}_G(y_0), \forall y_0\in Y,\forall x\in X$

另外在量子计算领域,群论也大有市场,当然,这个就很明显了,SU(N)群简直不要太重要,李群的各种理论也非常有用,我记得有用李群上的Haar 测度来定义量子计算比特的保真度的,总之不再赘述,希望新同学好好学习线性代数,上课听不懂就去看别的网课,实在是太有用了,群论some how在我看来就是线性代数加强版(指群表示论),只要学好线性代数,就肯定可以发顶刊了(确信)